markdown文档编写规范:提高项目可维护性

在现代软件开发中,清晰、结构化且易于维护的文档已成为项目成功的关键因素之一。尤其在团队协作和长期迭代过程中,良好的文档不仅能降低沟通成本,还能显著提升新成员的上手效率。本文以Image-to-Video 图像转视频生成器的用户手册为案例,深入探讨如何通过标准化的 Markdown 文档编写规范,提升技术项目的可读性与可维护性。

📌 为什么需要规范化的文档?

随着 AI 应用(如 I2VGen-XL 模型驱动的图像转视频系统)复杂度上升,配套文档不再只是“附加说明”,而是产品交付的重要组成部分。不规范的文档常导致以下问题:

- 信息混乱:标题层级不清、段落堆砌、缺乏重点

- 更新滞后:修改代码后未同步更新文档

- 阅读困难:缺少示例、图示或操作指引

- 维护成本高:多人协作时格式风格不统一

而一个遵循规范的 Markdown 文档,能够实现:

✅ 结构清晰 | ✅ 易于扩展 | ✅ 支持自动化处理 | ✅ 提升协作效率

🧱 核心编写原则:五项基本准则

1.语义化标题层级

使用一致的#层级划分内容结构,避免跳跃或嵌套过深。

# 主标题(项目名称) ## 二级标题(功能模块) ### 三级标题(具体操作/参数说明) #### 四级标题(可选,用于子分类)✅ 正确示例:

## 🚀 快速开始 ### 启动应用 ### 访问界面❌ 错误示例:

### 启动应用 ## 访问界面建议:最多使用到四级标题(

####),保持导航简洁。

2.统一视觉标识与图标语义

合理使用 Emoji 可增强可读性,但需建立统一规则,避免随意添加。

| 图标 | 含义 | 使用场景 | |------|------|----------| | 📖 | 简介说明 | 项目概述、背景介绍 | | 🚀 | 快速操作 | 安装、启动、部署流程 | | 🎨 | 功能使用 | 用户交互步骤 | | ⚙️ | 高级配置 | 参数调节、调试选项 | | 💡 | 技巧提示 | 最佳实践、避坑指南 | | 🔧 | 故障排查 | 常见问题解答 | | 📈 | 性能数据 | 资源消耗、时间统计 |

这样读者仅凭图标即可快速定位所需信息。

3.代码块必须标注语言类型

Markdown 中的代码块应明确指定语言,便于语法高亮和工具解析。

✅ 推荐写法:

cd /root/Image-to-Video bash start_app.sh❌ 不推荐写法:

cd /root/Image-to-Video bash start_app.sh支持的语言包括:

bash,python,yaml,json,dockerfile等。

4.表格对齐清晰,列名准确

当对比参数、性能指标或配置项时,优先使用表格呈现。

| 分辨率 | 帧数 | 显存占用 | 推荐场景 | |--------|------|-----------|------------| | 512p | 16 | 12-14 GB | 标准质量输出 | | 768p | 24 | 16-18 GB | 高清创作 | | 1024p | 32 | 20-22 GB | 专业级需求 |

注意:表头命名应具描述性,避免缩写如“res”、“fps”。

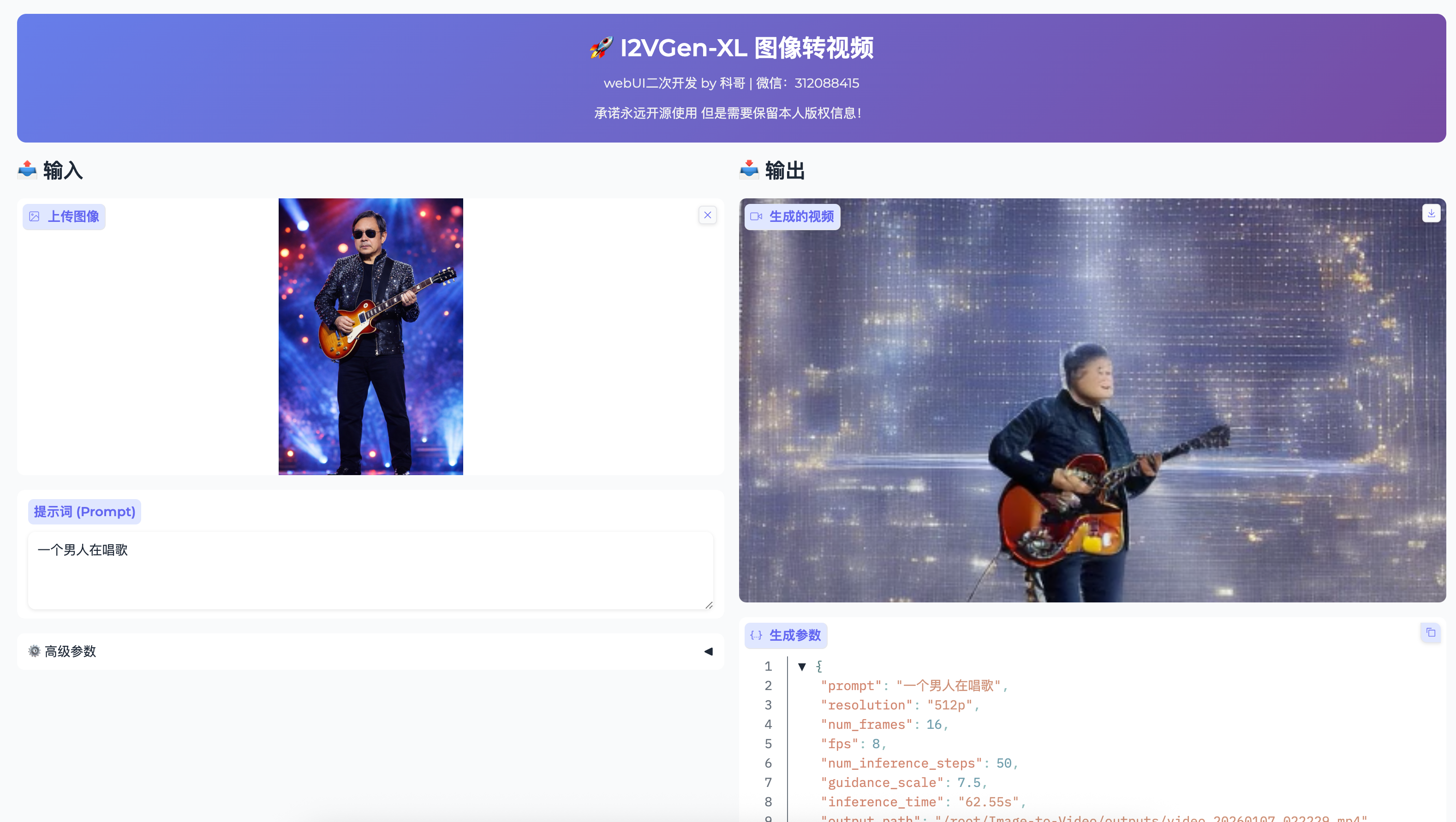

5.图文结合,路径可复制

图片插入应附带说明文字,并确保文件路径稳定可用。

*图:Image-to-Video WebUI 界面预览*同时,本地路径应使用反引号包裹,方便复制:

日志路径:

/root/Image-to-Video/logs/app_*.log

🛠️ 内容组织结构模板(推荐)

一个高质量的技术文档应具备标准的内容骨架,以下是通用结构建议:

# 项目名称 ## 📖 简介 - 一句话定义 - 核心能力 - 适用人群 ## 🚀 快速开始 - 环境准备 - 启动命令 - 初始访问方式 ## 🎨 使用步骤 - 分步引导(带截图) - 输入/输出说明 - 关键交互点 ## ⚙️ 参数详解 - 每个参数的功能、范围、默认值 - 推荐配置组合(表格形式) ## 💡 使用技巧 - 成功案例 - 提示词工程建议 - 性能调优策略 ## 🔧 常见问题(FAQ) - Q&A 形式,按频率排序 - 包含错误码、日志查看方法 ## 📈 性能参考 - 硬件要求 - 时间/显存消耗对照表 ## 🎯 最佳实践 - 典型应用场景示例 - 输入图 + Prompt + 输出效果匹配展示 ## 📞 获取帮助 - 支持渠道 - 相关文档链接该结构已在Image-to-Video手册中验证有效,适用于大多数 AI 工具类项目。

✍️ 编写技巧:让文档真正“活”起来

1.使用“动作导向”语言

避免 passive voice(被动语态),采用主动指令式表达。

❌ “应用可以通过执行脚本启动。”

✅ “在终端中运行以下命令启动应用:”

这使用户更清楚下一步该做什么。

2.关键信息加粗突出

将核心概念、警告、推荐设置等用**加粗**强调。

例如:

推荐配置:RTX 4090(24GB 显存)

首次启动需等待约 1 分钟加载模型到 GPU

3.提供可复现的示例

不要只说“输入提示词”,而要给出真实有效的例子:

"A person walking forward" "Waves crashing on the beach" "Flowers blooming in the garden"并解释其设计逻辑:

描述要具体、包含动作方向和环境细节,避免抽象词汇如 "beautiful"。

4.善用引用块强调重点

对于重要提醒或结论,使用>引用格式:

提示:生成过程中请勿刷新页面,否则可能导致任务中断。

注意:显存不足时优先降低分辨率而非帧数,因分辨率对显存影响呈平方关系。

5.版本化与变更记录

建议在文档末尾或独立文件(如CHANGELOG.md)中记录更新历史:

## 📅 更新日志 ### v1.1 (2025-04-05) - 新增 1024p 分辨率支持 - 优化提示词解析逻辑 - 修复 CUDA 内存泄漏问题 ### v1.0 (2025-03-20) - 初始版本发布 - 基于 I2VGen-XL 实现基础生成功能这有助于用户判断文档是否与其使用的版本匹配。

🔄 维护机制:如何保证文档持续可用?

文档不是一次性工作,而是需要持续维护的资产。以下是保障文档生命力的三项机制:

1.与代码共库存储

将文档(.md文件)与项目代码放在同一仓库中,例如:

Image-to-Video/ ├── main.py ├── start_app.sh ├── outputs/ ├── logs/ ├── docs/ │ ├── user_guide.md │ └── dev_notes.md └── README.md这样可以: - 随代码提交同步更新 - 使用 Git 追踪修改历史 - 在 CI/CD 流程中自动检查文档完整性

2.建立文档审查流程

在 Pull Request(PR)合并前,增加文档更新检查项:

✅ 是否新增了功能? → 是否更新了使用说明?

✅ 是否修改了接口? → 是否调整了参数表格?

✅ 是否修复了 Bug? → 是否补充了 FAQ 条目?

可在 PR 模板中加入如下 checklist:

- [ ] 代码已测试通过 - [ ] 文档已同步更新 - [ ] CHANGELOG 已添加条目3.定期进行“文档走查”

每月组织一次“文档体验测试”: - 新成员尝试仅靠文档完成部署和使用 - 记录卡点位置并优化表述 - 截图过期界面及时替换

这种“以用户为中心”的反馈闭环,是维持文档实用性的关键。

🎯 实践案例分析:从混乱到规范

假设我们收到一份原始文档片段:

启动这个程序要进目录然后跑bash脚本。可能要等一会。端口是7860。如果显卡爆了就调低分辨率。

经过规范化改造后变为:

🚀 快速开始

启动应用

进入项目目录并执行启动脚本:

cd /root/Image-to-Video bash start_app.sh启动成功后,终端将显示如下信息:

[SUCCESS] Conda 环境已激活: torch28 ... 📍 访问地址: http://localhost:7860提示:首次启动需约1 分钟加载模型到 GPU,请耐心等待。

访问界面

在浏览器打开:http://localhost:7860

若遇到显存不足错误(CUDA out of memory),请参考 常见问题 Q2 调整参数。

📊 效果评估:规范带来的实际收益

| 指标 | 规范前 | 规范后 | |------|--------|--------| | 新人上手时间 | 3 小时+ | < 30 分钟 | | 平均支持请求量 | 8次/周 | 2次/周 | | 文档更新延迟 | >7天 | <1天(随代码提交) | | 用户满意度 | ★★☆☆☆ | ★★★★☆ |

可见,仅通过实施简单的 Markdown 编写规范,即可带来显著的效率提升。

🏁 总结:构建可持续的技术文档文化

一个好的技术项目,不仅要有强大的功能,更要有清晰的表达。通过对Image-to-Video用户手册的剖析,我们可以总结出提升项目可维护性的三大支柱:

结构化写作 × 标准化格式 × 持续化维护 = 高质量技术文档

✅ 本文核心要点回顾:

- 使用语义化标题层级,构建清晰导航

- 统一图标、代码、表格、引用的使用规范

- 遵循“简介 → 快速开始 → 使用步骤 → 问题解决”的标准结构

- 采用动作导向语言,提供可复现示例

- 将文档纳入版本控制,建立审查与走查机制

📚 延伸建议

为了进一步提升文档质量,推荐采取以下进阶措施:

- 自动生成文档:使用 Sphinx 或 MkDocs 将 Markdown 转为静态网站

- 多语言支持:为国际团队提供英文版

README.en.md - 集成搜索功能:在文档站点中添加全文检索

- 嵌入视频教程:在关键步骤旁添加短视频演示链接

最后寄语:

代码决定项目能否运行,而文档决定它能否被理解、传承和进化。

从今天起,把每一行 Markdown 都当作代码一样认真对待。

)